Deep featureは捕食者の視覚を模倣するのに役立つか?

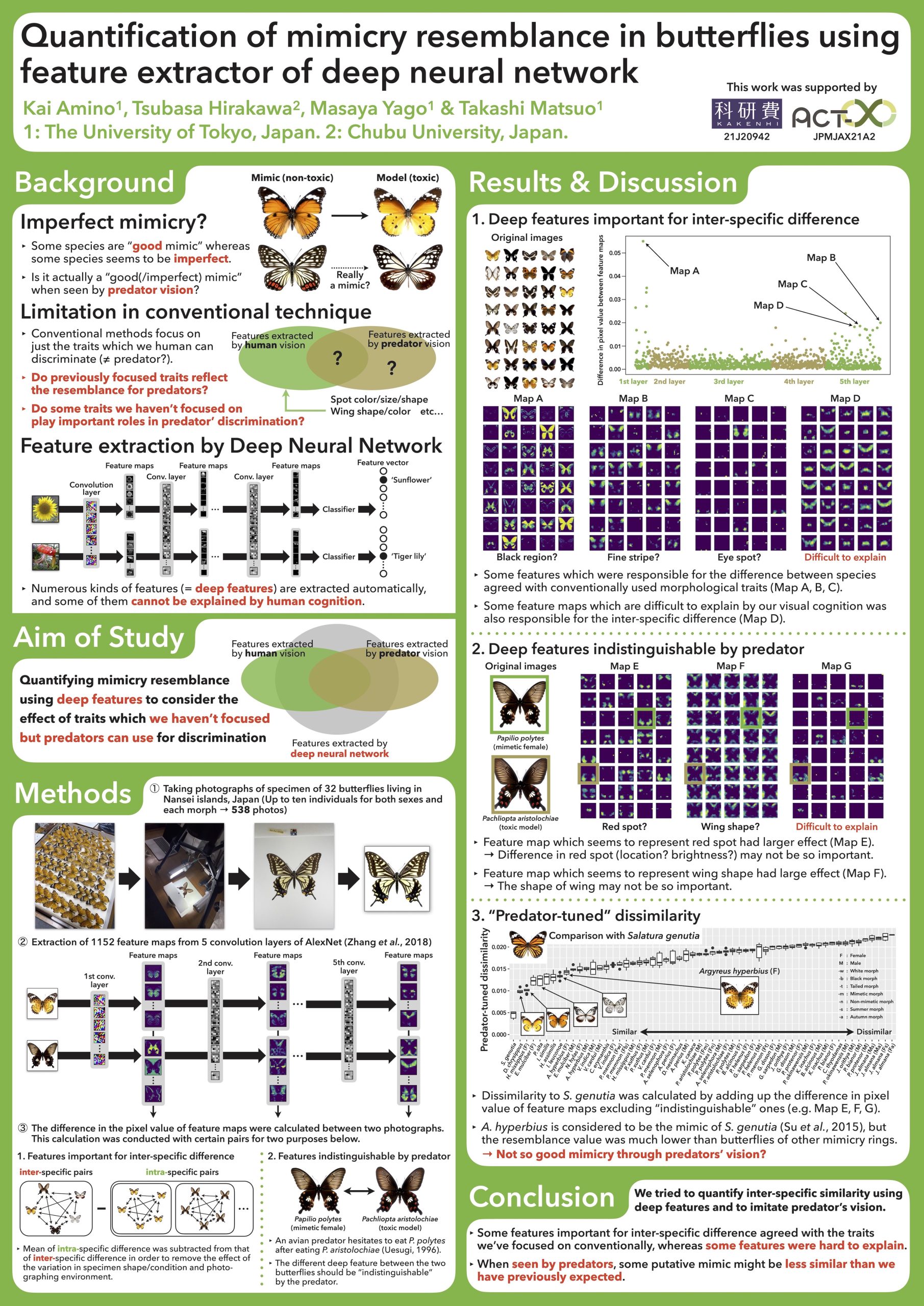

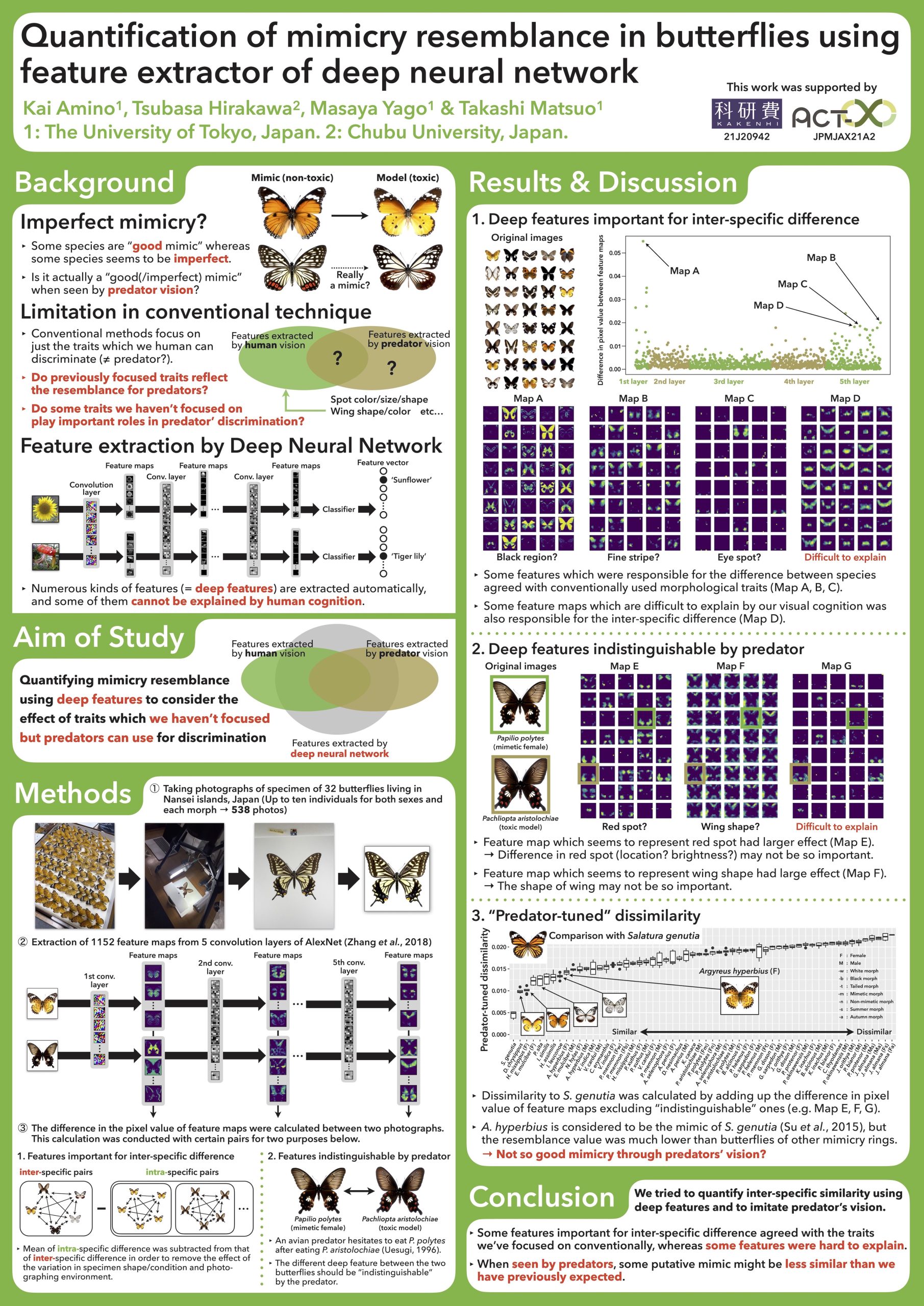

沼津で開催された日本進化学会第24回年大会およびチェコで開催されたESEB2022 (Congress of Europian Society for Evolutionary Biology)にて発表を行いました。以下にESEB2022でのポスターを載せています。

Deep featureは捕食者の視覚を模倣するのに役立つか?

沼津で開催された日本進化学会第24回年大会およびチェコで開催されたESEB2022 (Congress of Europian Society for Evolutionary Biology)にて発表を行いました。以下にESEB2022でのポスターを載せています。